طی بررسی آزمون اخلاقی هوش مصنوعی اتومبیل های خودران، میفهمیم که آیا هوش مصنوعی میتواند تصمیمات اخلاقی درستی بگیرد؟

در این مطلب تصمیم دارم درباره ی ابعاد اخلاقی هوش مصنوعی، به طور اخص اتومبیل های خودران صحبت کنم و شما را دعوت میکنم که با هم طی بررسی آزمون اخلاقی هوش مصنوعی ، به مسائلی فکر کنیم که شاید کمتر بهشون پرداخته شده.

هوش مصنوعی اصلاً چی هست؟

Artificial Intelligence یا همون هوش مصنوعی در مقابل هوش طبیعی قرار میگیره. هوش طبیعی قدرتیه که در انسان ها وجود داره و وظیفش تصمیم گیری و انجام امور به شیوه ای خردمندانه هست. خود این معقولهی هوش دارای تعریف علمی دقیقی نیست. دانشمندان دربارهی تعریف هوش تا الان به اجماعی نرسیدند و تعاریف بسیار زیادی وجود داره برای هوش. هوش رو گاهی به جای منطق، یادگیری،خودآگاهی، آگاهی عاطفی، ادراک، خلاقیت و حتی شیوه تفکر نقادانه به کار میگیرند. توی همین قسمت بحث، متوجه خواهیم شد که با معقولهی پیچیده ای روبرو هستیم. چیزی که حتی تعریف مشخصی نداره.

بیشتر بخوانید: هوش مصنوعی خودکفا ؛ تا تولد این ماشین های هوشمند سوپر انسانی چقدر راه مانده؟

هوش مصنوعی در واقع شبیه سازی هوش انسان در ماشین هست. طوری که ماشین برنامه ریزی بشه تا مثل انسان بتونه در یک محدوده ی مشخصی فکر کنه و بتونه کنشهای آدم رو تقلید کنه.

اگر اخبار مربوط به هوش مصنوعی رو دنبال میکنید حتماً میدونید که هوش مصنوعی در تکنولوژی امروز دنیا نقش بسیار مهمی رو ایفا میکنه و بسیار بسیار پیشرفت کرده و حتی گاهی اوقات از انسان پیشی گرفته و در رقابت هایی حتی انسان رو شکست داده. به عنوان مثال شکست کاسپاروف قهرمان نامی شطرنج جهان از یک کامپیوتر یا شکست خوردن قهرمان جهان بازی “go” از یک کامپیوتر دیگه.

بازی “go” یک بازی رومیزیه و در سطح حرفهای بسیار بازی پیچیدهای هست. پروژهای به نام Alphago توسط شرکت DEEP MIND توسعه داده شد و یک برنامه کامپیوتری طراحی شد که این برنامه، بازی “go” رو تماشا میکرد و یاد میگرفت. با انسان ها و با کامپیوتر بازی میکرد و دائم قوی و قوی تر شد تا اینکه تونست قهرمان اروپا و قهرمان جهان در این بازی رو شکست بده و ترسناک بودن و حیرت انگیز بودن هوش مصنوعی رو به جهانیان یادآوری کنه.

بیشتر بخوانید: هوش مصنوعی و درمان کرونا ؛ هوش مصنوعی ما را از دست کروناویروس نجات نمی دهد

بردن در بازی “go” از قهرمان جهان غیر از تسلط به قوانین و همه ی فوت و فن های بازی، یک میزانی خلاقیت هم نیاز داره. پیش بینی حرکات رقیب که یک انسان هست و عکس العمل نشون دادن با توجه به اون پیش بینی ها. بروز خلاقیت در ماشین همزمان هم حیزت انگیزه و هم ترسناک! در همین پروژه ی Alphago یک برنامه نوشته شده که کامپیوتر خودش شروع میکنه به یادگرفتن و اونقدر قوی میشه که میتونه از قهرمان جهان ببره بدون اینکه یک انسان کمکش کنه. بدون دخالت انسان تصمیم گیری میکنه.

در این پروژه ای که دربارش صحبت کردم یک بازی اتفاق میوفته اما اگر ما انسان ها تصمیم بگیریم از هوش مصنوعی در جاهایی استفاده کنیم که مرگ و زندگی انسان ها درگیرش بشه چی ؟ اگر مثلاً یک پلیس رباتی داشته باشیم و این ربات که با هوش مصنوعی و یادگیری ماشینی کار میکنه، تصمیم بگیره در یک شرایط خاصی به یک انسان شلیک کنه چی میشه؟

اگر پیش خودتون داری فکر میکنید هرگز این اتفاق نمیوفته بگذارید بهتون بگم که در سال 2016 یک پلیس رباتی تخم مرغی شکل در پالو آلتو که عکسش رو براتون کمی بالاتر گذاشتم در یک مرکز خرید از روی پای یک کودک 16 ماهه رد شد و به پای اون کودک آسیب زد. این پلیس های رباتی تخم مرغی شکل، تفنگ ندارند و عمده وظیفشون تذکر دادن و راهنمایی کردن آدمهاست. در صورتی هم که اتفاق خاصی بیافته میتونند به پلیس زنگ بزنند.

بیشتر بخوانید: ترکیب هوش انسانی و هوش مصنوعی ، سوپر هوشی که بشر به آن نیاز دارد….

حالا قبل از اینکه به سراغ ماشین های خودران بریم، بهتره نقل قولی بیارم از آدمی که اسمش با ماشین های خودران گره خورده و خودش صاحب یکی از غولهای این صنعت یعنی ابرکمپانی تسلاست. بله درست حدس زدین، جناب ایلان ماسک دربارهی هوش مصنوعی میفرمایند که: خطر هوش مصنوعی خیلی خیلی بیشتر از خطر بمب اتمیه. حالا با رابطه ی دوگانه ایلان ماسک و هوش مصنوعی خیلی کاری نداریم چون نظرات بسیار جالبی داره و شاید در یک مطلب دیگه دربارش براتون بنویسم، اما وقتی ایلان ماسک این حرف رو میزنه باید کنجکاو بشیم که دقیقاً چه خبره؟

بله تسلط هوش مصنوعی در تکنولوژی ، تهدید ها و فرصت های خاص خودش رو داره. به قول ایلان ماسک دیر نیست اون روزی که هوش مصنوعی مشاغل انسان ها را ازشون بگیره و کاری نیست که بزودی هوش مصنوعی بهتر از انسان و سریعتر انجامشون نده.

ماجرا اینه که در نهایت این ماشین های هوشمند رو ما انسان ها طراحی میکنیم و میسازیم. نکته ی مهم اینه که اون کسی که داره این هوش مصنوعی رو طراحی میکنه، الویت هاش چیه؟ این هوش مصنوعی منافع چه کسانی رو داره تامین میکنه؟ و سوال جالب تر اینکه آیا ما میتونیم به این ماشین های هوشمند، اخلاقیات هم بیاموزیم؟

بگذارید برای روشن شدن ماجرا یک مثالی بزنم تا معاوم بشه از چی داریم صحبت میکنیم؟!

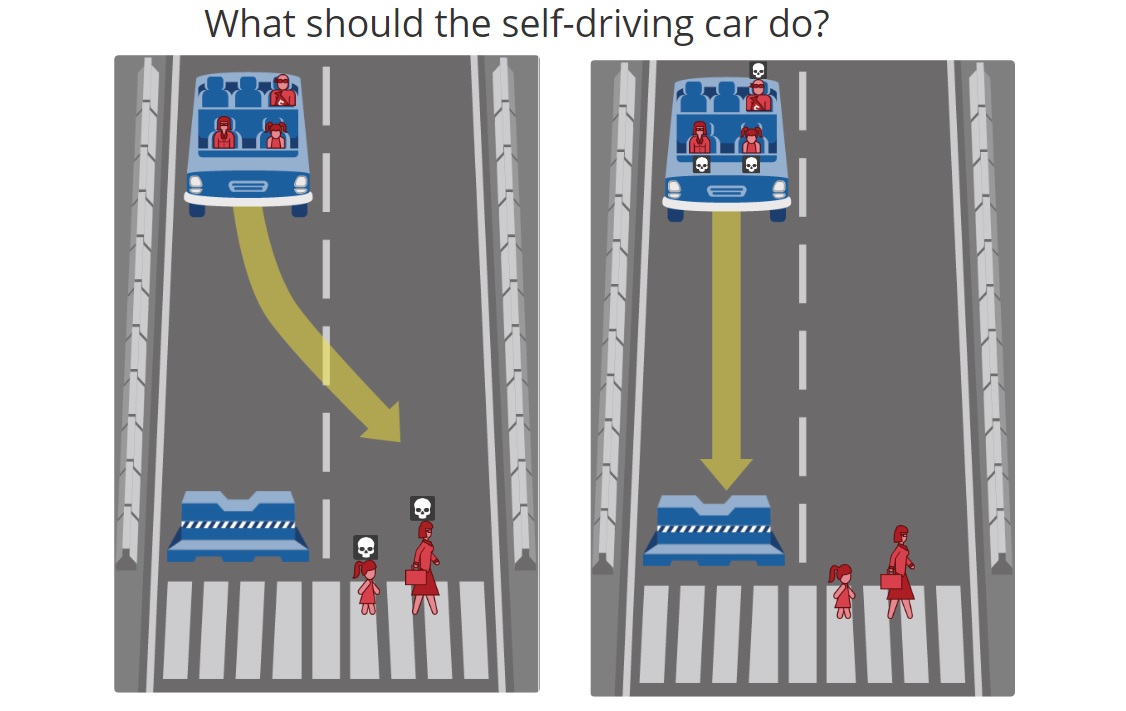

تصور کنید یک ماشین خودران در شرایطی قرار بگیره که مجبور باشه بین کشتن یا آسیب زدن سرنشینان خودش یا کشتن و آسیب زدن یک مادر و بچه خردسالش یکی رو انتخاب کنه.

بیشتر بخوانید: هوش مصنوعی در پزشکی، تحولی عظیم در درمان بیماری ها!

سایتی به نام moral machine یک سری تست طراحی کرده و از شما میخواد که بین این گزینه ها یکی رو انتخاب کنید و در پایان هم نتیجه ی انتخاب های شما رو بهتون اعلام میکنه. پیشنهاد میکنم حتماً به این سایت سر بزنید و به این سوال که ماشین های خودران در جایی که صحبت از انتخاب اخلاقی یا عاطفی هست کدام رو باید انتخاب کنه فکر کنید.

به نظر شما اون شرکتی که این هوش مصنوعی و این ماشین خودران رو طراحی کرد باید منافع مشتریانش رو در الویت قرار بده یا واکنش های اخلاقی رو برای کامپیوتر کدنویسی کنه؟

لطفاً برای این پست کامنت بگذارید و نظرتون رو بگید. آزمون اخلاقی هوش مصنوعی از اون بحث هایی هست که باید دربارش صحبت بشه تا بتونیم از زوایای مختلف بهش نگاه کنیم.

در نهایت به نظر من این سوال که هوش مصنوعی در خدمت چه کسانی باید باشه، دغدغه ی اصلی اجتماعی همه ی مردم در همه جای جهان خواهد بود و خوبه که ما هم بهش فکر کنیم و خودمون رو برای آینده ی حیرت انگیز و همزمان ترسناک آینده ی تکنولوژی آماده کنیم.